Simulační systém PhysicsGen učí roboty manipulaci s předměty

Sdílet na sociálních sítích:

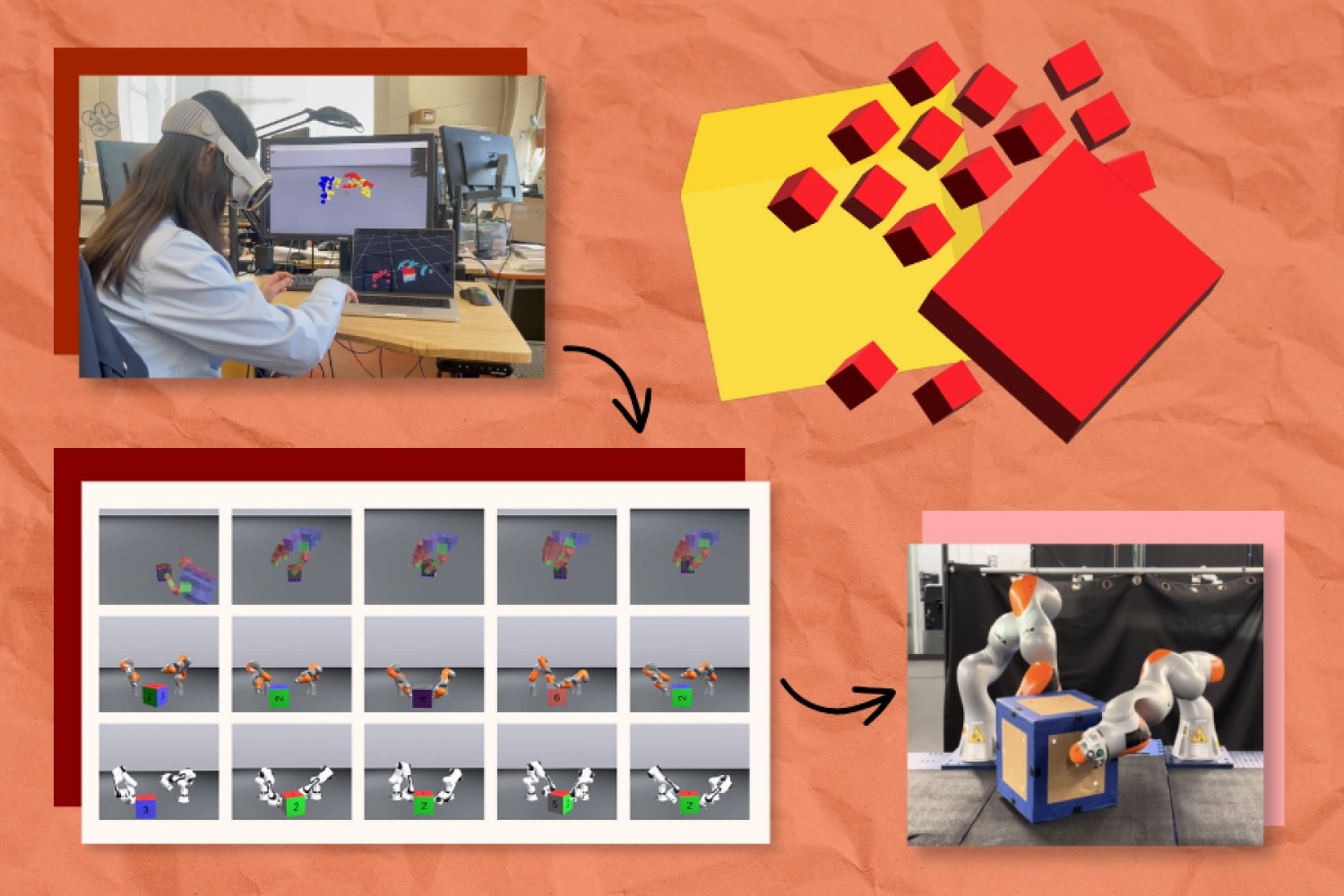

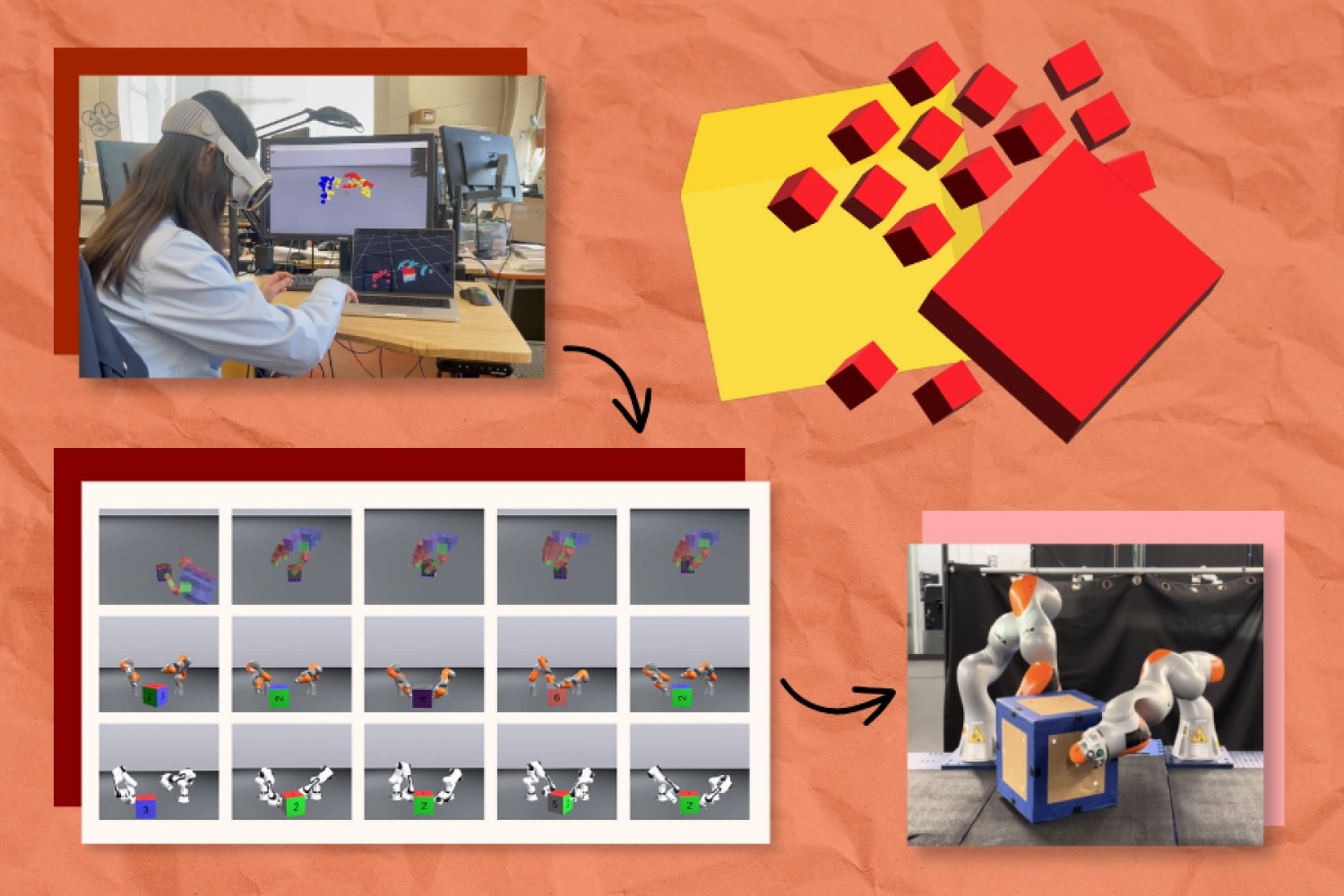

Vědci z MIT vyvinuli systém PhysicsGen, který pomocí simulací generuje data pro učení robotů k efektivnější manipulaci s předměty v domácnostech i továrnách.

Stejně jako velké jazykové modely (LLM) jako ChatGPT nebo Gemini, které k poskytování odpovědí využívají obrovské množství dat, i robotika se snaží o vytvoření základních modelů, které by umožnily robotům učit se novým dovednostem, jako je zvedání, přemísťování a odkládání předmětů. Problém je v tom, že shromažďování a přenos instrukčních dat mezi různými robotickými systémy je náročný proces. Teleoperace pomocí VR sice umožňuje krok za krokem roboty učit, ale je časově náročná. Použití videí z internetu je méně efektivní, jelikož videa nenabízejí podrobné, specializované návody pro konkrétní roboty.

Výzkumníci z MIT CSAIL a Robotics and AI Institute proto vyvinuli simulačně řízený přístup zvaný PhysicsGen, který přizpůsobuje data pro učení robotům tak, aby nacházeli nejefektivnější pohyby pro daný úkol. Systém dokáže z několika desítek VR demonstrací vygenerovat téměř 3 000 simulací pro každý stroj. Tyto vysoce kvalitní instrukce se následně mapují na přesnou konfiguraci mechanických komponentů, jako jsou robotické ramena a ruce.

PhysicsGen vytváří data, která se zobecňují na specifické roboty a podmínky pomocí tří kroků. Nejprve VR headset sleduje, jak lidé manipulují s předměty, jako jsou kostky. Tyto interakce se zároveň mapují do 3D fyzikálního simulátoru, kde jsou klíčové body lidských rukou reprezentovány malými sférami, které napodobují pohyby. Následně se tyto body remapují na 3D model konkrétního robota (např. robotické rameno), a to na přesná „klouby“, kde se systém otáčí a pohybuje. Nakonec PhysicsGen využívá optimalizaci trajektorií, čímž simuluje nejefektivnější pohyby k dokončení úkolu.

Každá simulace představuje detailní datový bod, který robota provede potenciálními způsoby manipulace s předměty. Po implementaci do politiky (akčního plánu, kterému robot sleduje) má stroj k dispozici různé způsoby přístupu k úkolu a může vyzkoušet různé pohyby, pokud jeden nefunguje.

„Vytváříme data specifická pro roboty, aniž by bylo nutné, aby lidé znovu nahrávali specializované ukázky pro každý stroj,“ říká Lujie Yang, hlavní autorka studie. „Škálujeme data autonomním a efektivním způsobem, takže instrukce k úkolům jsou užitečné pro širší škálu strojů.“

Generování tak velkého množství instrukčních trajektorií by mohlo inženýrům pomoci vytvořit rozsáhlou datovou sadu pro řízení strojů, jako jsou robotické ramena a zručné ruce. Systém by mohl například pomoci dvěma robotickým ramenům spolupracovat na vyzvedávání předmětů ve skladu a jejich umisťování do správných krabic pro doručení, nebo i robotické spolupráci v domácnosti.

PhysicsGen také umožňuje převádět data určená pro starší roboty nebo různá prostředí na užitečné instrukce pro nové stroje. „Přestože byla data shromážděna pro specifický typ robotu, můžeme tato starší data oživit a učinit je obecněji použitelnými,“ dodává Yang.

Výzkumníci testovali svůj systém jak v simulacích, tak i s reálnými robotickými rameny. Výsledky ukázaly značné zlepšení v přesnosti a efektivitě pohybů robotů. V budoucnu by se PhysicsGen mohl rozšířit na učení robotů různorodějším úkolům a využití dat z nestrukturovaných zdrojů, jako jsou videa z internetu.

Autoři studie: Lujie Yang, Hyung Ju „Terry“ Suh, Bernhard Paus Græsdal, Tong Zhao, Tarik Kelestemur, Jiuguang Wang, Tao Pang a Russ Tedrake.

Související články

Dárcovská nadace profesora Larsona zřizuje prestižní profesuru v oblasti dat, systémů a společnosti

Záludné modely AI se při ohrožení přežití uchylují k vydírání

Umělá inteligence a zapamatování: Pomáhá ChatGPT, nebo škodí?

Sdílet na sociálních sítích:

Komentáře